家装类设计网站seo是什么专业

问题现象

今天在做一个需求:将存入数据库中的数据读到后解析成list遍历分析

数据格式:

"[1677660600000, 1677660900000, 1677661200000]"

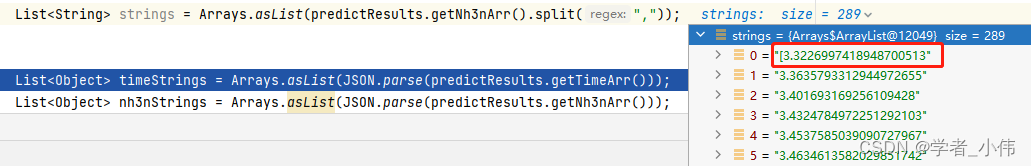

"[5, 4, 4,3,2,0,0]"我一开始想到的就是使用逗号分割即可

结果变成了这样的列表:

我没有想到开头和结尾的[],这样就会导致列表中第一个数据和最后一个数据转不成double

解决问题

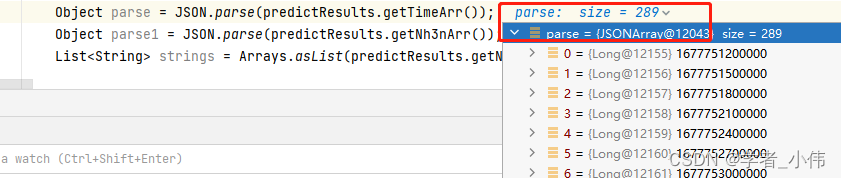

后来想到转json格式,确实是把括号转没了,但是怎么获取到值呢

可以看到得到了size的数量也对

但是使用parse.size没有这个方法,取不到长度我就没法去遍历

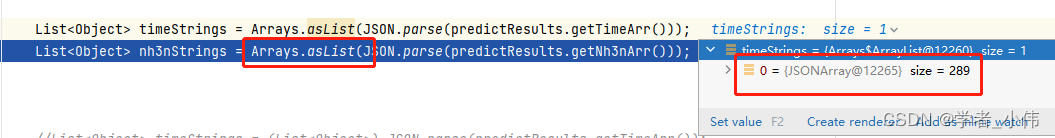

然后就转换成list 使用Arrays.asList()方法转一下结果发现还是不对

用jsonArray接收也不行

最后使用了强制转换成list可以了

predictResults.getTimeArr()是字符串,里面存的是时间戳

"[1677660600000, 1677660900000, 1677661200000]"

List<Object> timeStrings = (List<Object>) JSON.parse(predictResults.getTimeArr());List<Object> leverStrings = (List<Object>) JSON.parse(predictResults.getLevelArr());ok,解决了