深圳哪家做网站企业网站优化方法

【小白从小学Python、C、Java】

【计算机等考+500强证书+考研】

【Python-数据分析】

将二进制数a的

每一位右移b位

operator.rshift(a,b)

[太阳]选择题

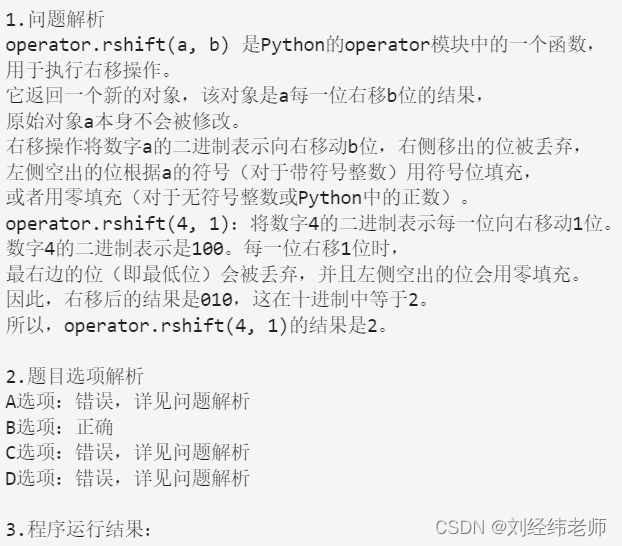

请问执行operator.rshift(4, 1)的结果为?

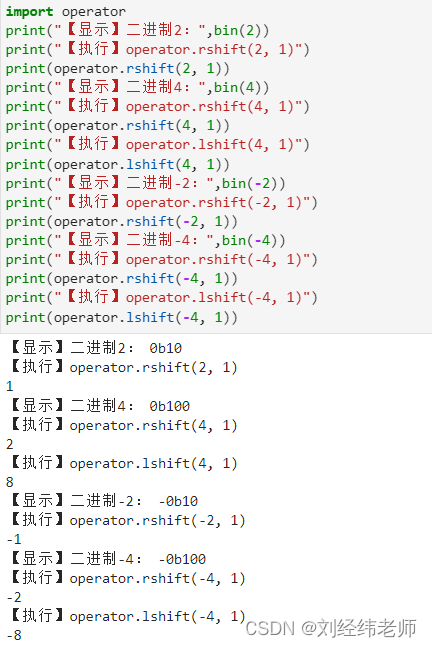

import operator

print("【显示】二进制2:",bin(2))

print("【执行】operator.rshift(2, 1)")

print(operator.rshift(2, 1))

print("【显示】二进制4:",bin(4))

print("【执行】operator.rshift(4, 1)")

print(operator.rshift(4, 1))

print("【执行】operator.lshift(4, 1)")

print(operator.lshift(4, 1))

print("【显示】二进制-2:",bin(-2))

print("【执行】operator.rshift(-2, 1)")

print(operator.rshift(-2, 1))

print("【显示】二进制-4:",bin(-4))

print("【执行】operator.rshift(-4, 1)")

print(operator.rshift(-4, 1))

print("【执行】operator.lshift(-4, 1)")

print(operator.lshift(-4, 1))

A选项:1

B选项:2

C选项:0.2

D选项:8

正确答案是:B

图1 问题解析

图2 题目代码

欢迎大家转发,一起传播知识和正能量,帮助到更多人。期待大家提出宝贵改进建议,互相交流,收获更大。辛苦大家转发时注明出处(也是咱们公益编程交流群的入口网址),刘经纬老师共享知识相关文件下载地址为:https://liujingwei.cn