东莞五金网站建设做网站需要会什么语言

PDF 转 Word 转换工具只是一个特殊程序,可以将 PDF(本机和/或扫描)转换为 Microsoft Office Word 格式。将 PDF 导出到 Word 的主要原因之一是满足可编辑文档的需求,尽管还有其他原因。

由于缺少 PDF 阅读器,您可以选择将 PDF 保存为 DOC 或 DOCX、提取特定文本数据、支持盲人屏幕阅读器、通过避免重新输入来节省时间等等。当然,实现这一壮举需要最好的 PDF 转 Word 转换器软件,本文将带您踏上探索您可以使用的各种首选程序的旅程。

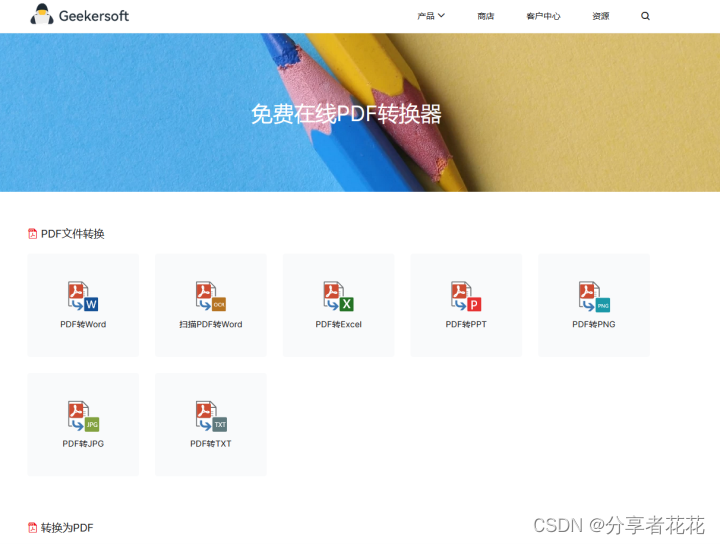

#1. 奇客PDF 转换器(免费)

奇客PDF转换器是最好的 PDF 到 Word 转换器,它提供了一种将 PDF 转换为其他可编辑格式(如 Word、PowerPoint、Excel 等)的简单方法。它支持本机和扫描 PDF,以输出非常高质量和可编辑的 DOCX 文件。您有机会根据需要转换特定页面和页面,尤其是在不需要导出整个 PDF 文件时。

PDF转Word_PDF在线转换_PDF格式转换-奇客在线PDF转换器奇客PDF能让您轻松惬意地将PDF文件转换为Word,PPT,Excel,JPG,PNG,TXT等各种文件格式,也能将其它文件格式转换为PDF文件。文件转换过程不需要您注册账号或安装软件。![]() https://www.geekersoft.cn/pdf-converter-online.html

https://www.geekersoft.cn/pdf-converter-online.html

更好的是,您可以根据您想要的可编辑 DOC 文件类型在格式优先级、编辑优先级和 OCR 模式之间进行选择。OCR 支持多达 46 种语言,其准确性无与伦比。将所有这些与简单的用户界面相结合,使 TalkHelper PDF Converter 成为离线 PDF 到 Word 转换领域的佼佼者。

优点:

过于强大的内置 OCR

提供批量转换选项

高质量的可编辑 Word 文件,保留布局和格式

提供多种转换模式

缺点:

仅限 Windows

支持平台: Windows Vista/7/8/8.1/10/11

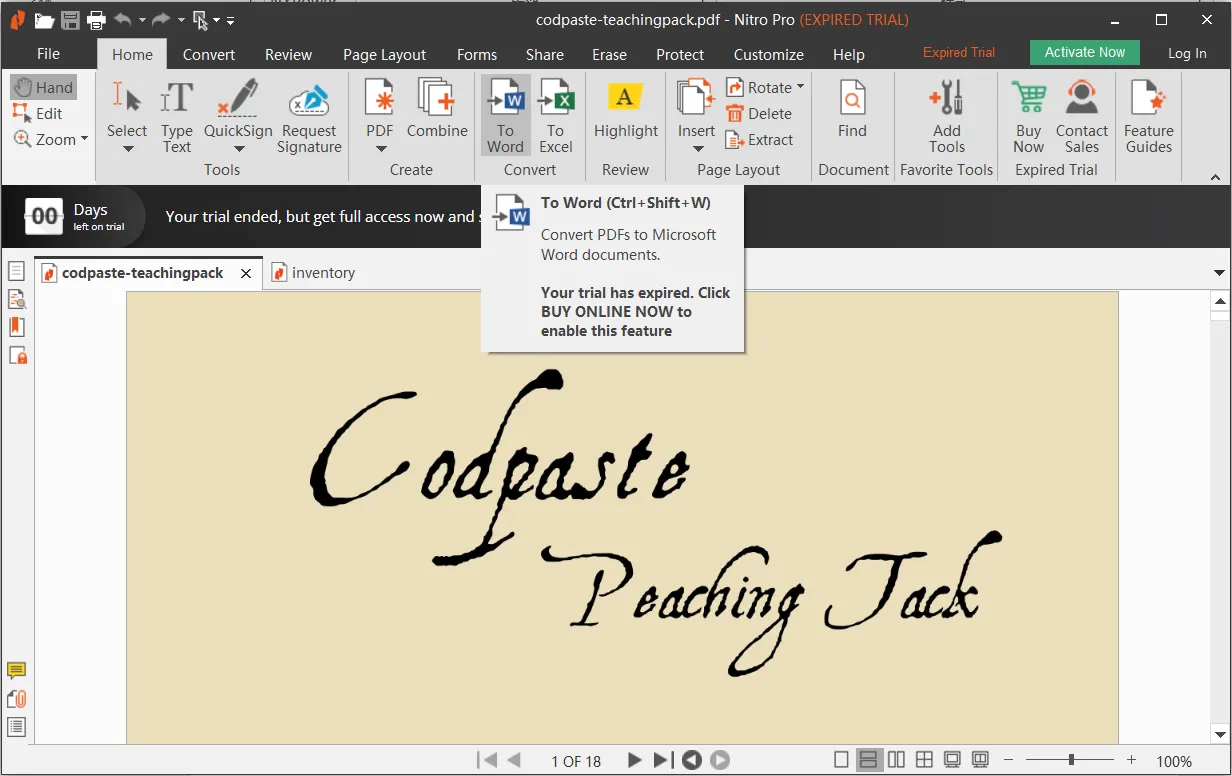

#2. 硝基专业版

作为专业的 PDF 到 Word 转换器工具之一,Nitro Pro 向您承诺一个顺利的过程,保证积极的进展。由于 Nitro Pro 能够从 PDF 导出可编辑的 Word 文档,您现在终于可以告别大量的复制和粘贴。输出的 DOC 或 DOCX 文件将保持美观,保留原始图像、字体和一致的格式。

这里的一个很棒的功能是,您还可以直接将电子邮件和附件中的 PDF 转换为 Microsoft Word 文件,而无需先下载 PDF。更好的是,对批处理的支持有助于只需一个简单的步骤即可转换多个 PDF 和整个 PDF 文件夹。

优点:

保留原始布局和格式

支持批量转换

提供 PDF 编辑器

类似 Office 的简单界面

集成了一些云选项

缺点:

与同行相比价格昂贵

有限的免费版本

支持的平台: Windows、Mac

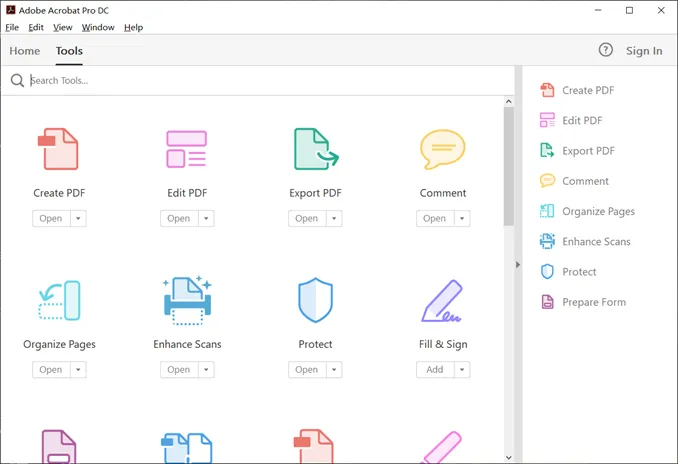

#3. Adobe Acrobat 专业版

Adobe 率先推出了 PDF 格式,因此非常适合在线和离线处理 PDF 到 Word 的转换。它是最好的 PDF 到 Word 转换器软件之一,非常注重高质量输出和顶级效率(快速转换)。

您会很高兴知道所有字体、表格、页边距、图像和其他文档组件都按照输出 Word 文件中的原样保留下来。得益于非常勤奋的 OCR 工具,整体准确度也提高了一个档次。令人惊奇的是,您可以轻松地对整个文档、单个页面甚至选定的部分进行 OCR。此外,同时转换多个 PDF 是一个很好的功能,可以减少一个又一个 PDF 转换的时间。

优点:

快速将 PDF 转换为 DOCX

批量转换选项

强大的内置 OCR

提供操作向导

支持原生 PDF 和扫描 PDF

可在多个平台上使用

缺点:

非常贵

支持的平台: Windows、Mac、Android、iOS、基于网络

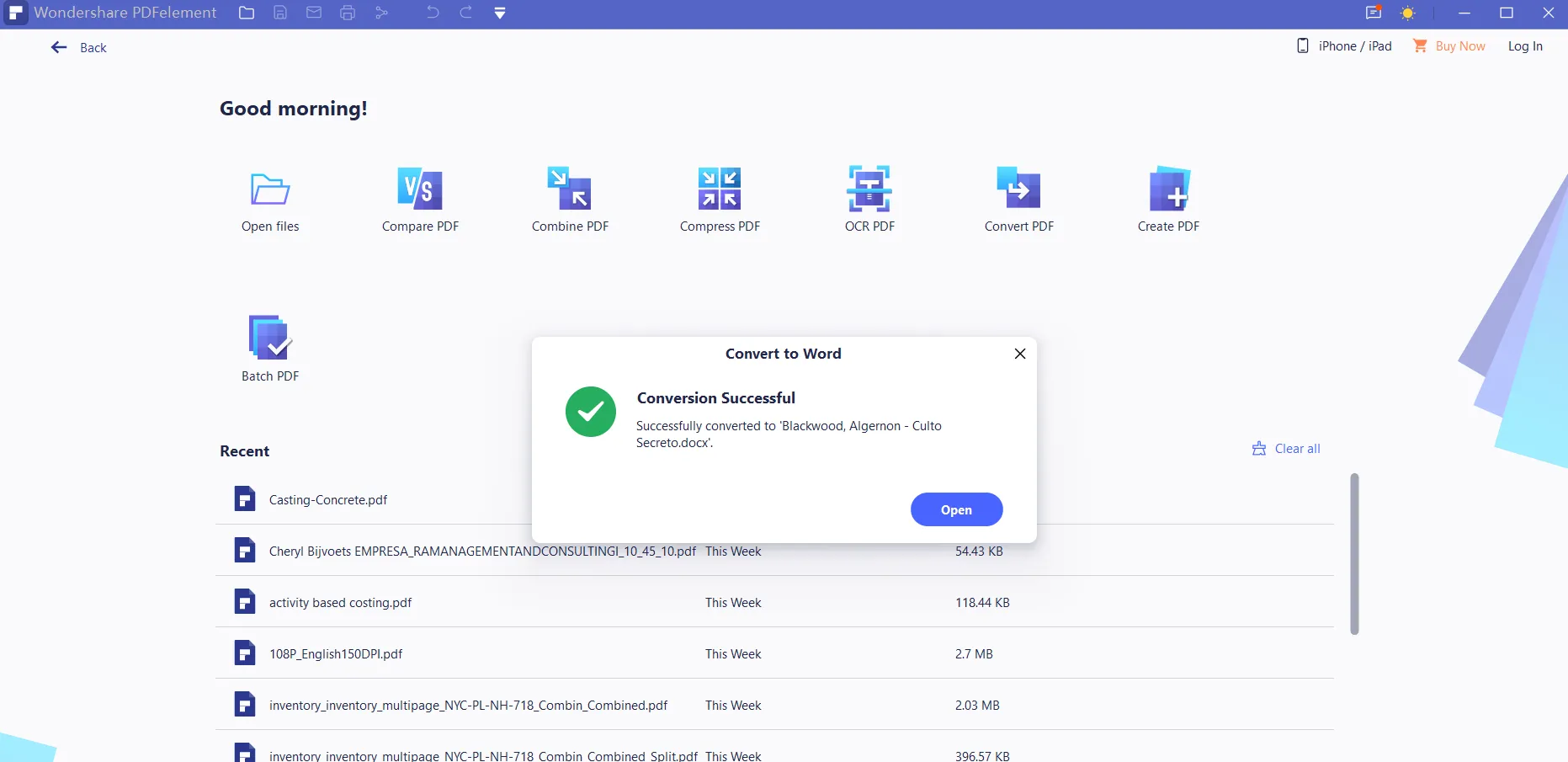

#4。万兴PDF专家

万兴PDF专家是所有PDF转Word任务的首选离线桌面解决方案。个人、团队、学生和企业可以利用大量功能来获得适当的 PDF 管理选项。一是您可以根据自己的喜好将 PDF 转换为 DOC 或 DOCX 格式,并输出清晰的高质量文档。

即使在转换之前,万兴PDF专家也允许您在将 PDF 文件导出为 Word 文件之前对其进行一些编辑。除了令人垂涎的批量转换选项之外,嵌入式 OCR 工具也足够强大,可以轻松地从扫描和基于图像的 PDF 中准确提取文本数据。大文件还可以转换和压缩以输出小Word文档。

优点:

允许您执行部分转换

拥有强大的 OCR 功能

高质量输出

允许您在转换之前编辑 PDF

可以轻松转换大型 PDF 文件

缺点:

有点贵

支持的平台: Windows、Mac

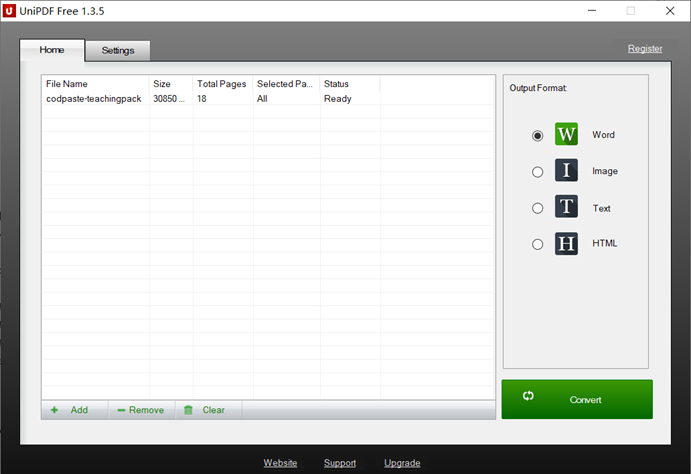

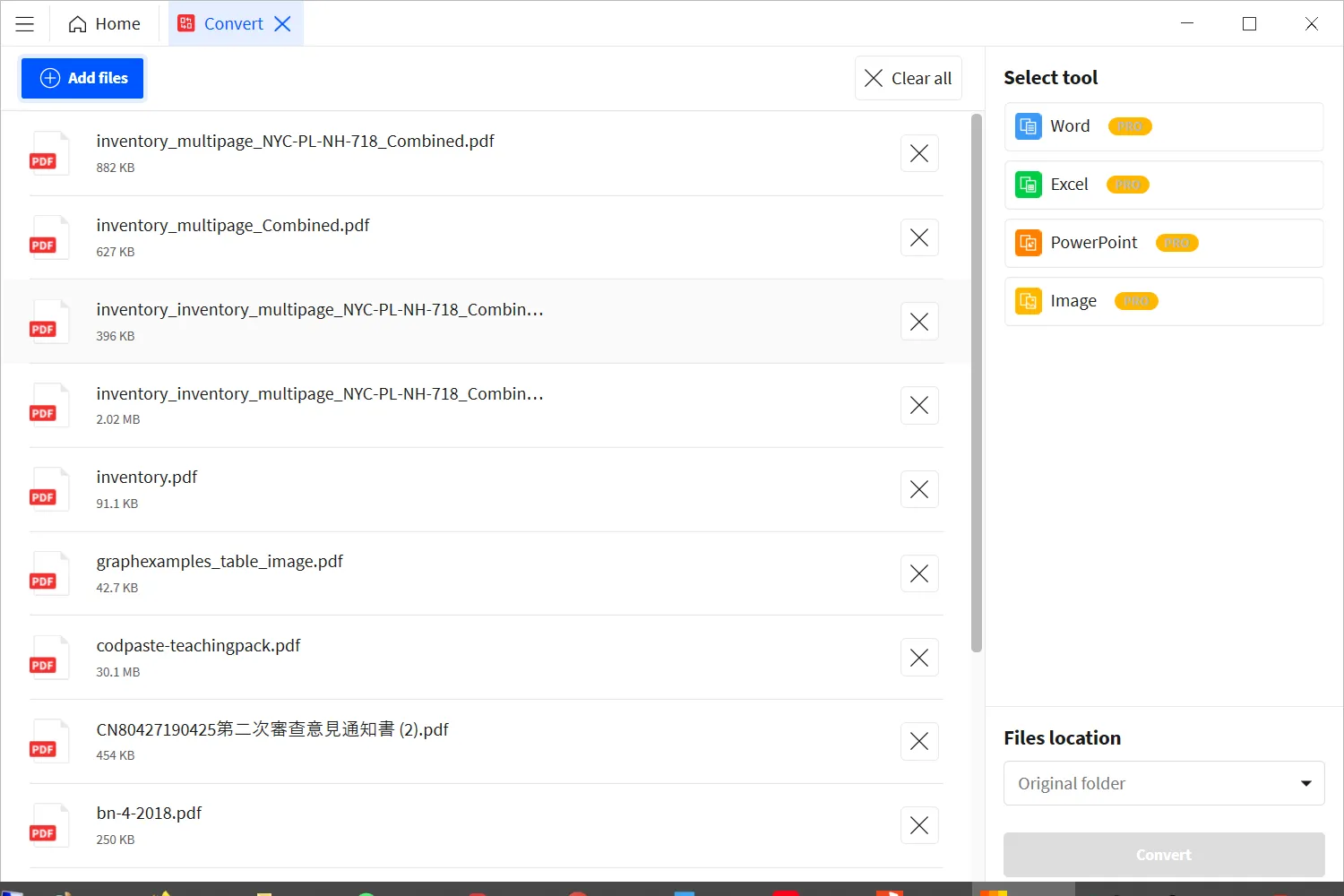

#5。UniPDF PDF 到 Doc 转换器

UniPDF 是一款流行的多语言且 100% 免费的工具,用于在 Windows 上将 PDF 转换为 Word。有了它,您可以批量转换多个 PDF,同时保留原始文本、布局、图像和常规格式。除了 Microsoft Word 之外,您还可以将 PDF 转换为图像、文本和 HTML 文件。

您还将体验到闪电般的转换速度,从而节省大量的时间和精力。此外,当不需要转换整个 PDF 文件时,您可以执行部分转换,从而保存特定页面或页面范围。更好的是,UniPDF 具有 20 多种用户界面语言,您可以本地化 UniPDF 以方便使用。

优点:

支持部分和批量转换

保留原始布局和格式

超快且不影响质量

多语言用户界面

缺点:

免费版本没有批量转换

免费版本只需 3 天即可转换无限量的 PDF

无光学字符识别

#6. 小PDF

SmallPDF 是一款免费的 PDF 到 Word 解决方案,可让您走上提高生产力和智能工作的道路。具体来说,您只需几个步骤即可转换、编辑和压缩文档。与其他仅集成 Dropbox 和 Google Drive 的应用程序不同,Smallpdf 还为 Pro 用户提供云存储。

通过与 Solid Documents 合作,您每次将 PDF 导出到 Word 时都可以获得最佳质量。您可以上传大文件,没有大小限制,并且无需注册即可使用这些功能。为了与其他在线 PDF 转换器保持一致,我们始终保证您的文件隐私。请放心,原始格式将被保留,并且附带的 OCR 会将任何扫描的 PDF 页面转换为可编辑的 Word 文档。

优点:

包含 OCR 工具

无需注册即可使用

无文件大小限制

适用于所有平台

提供批量转换选项

缺点:

OCR和Smallpdf云服务是付费功能

支持的平台: Windows、Mac、基于 Web

#7. WPS PDF 到 Word 转换器

WPS PDF to Word Converter 提供基于浏览器的工具中最好的转换质量级别之一。我们保证您上传的 PDF 和下载的 Word 文档拥有 100% 的隐私,同时也不会忘记在所有操作系统上的可用性。

这个在线 PDF 到 Word 转换器不仅可以导出 Word 文件,还可以对输出应用某种压缩。此外,我们还为您提供免费的云存储来存储转换后的 Word 文件和模板,帮助您进一步简化流程。要处理从扫描或基于图像的 PDF 中提取数据,内置 OCR 功能可供您使用。

优点:

内置 OCR

非常高质量的输出

多平台

提供云存储

文件隐私和安全

缺点:

试用期短

免费用户的 1 页转换限制

支持的平台: Windows、Mac、基于 Web

#8.爱PDF

iLovePDF 更多地被认为是一个在线 PDF 到 Word 转换器工具,尽管它仍然为爱好者提供离线桌面版本;谈论平台自由。它拥有令人难以置信的准确性,同时仍然提供尽可能小的 Word 文档,而不会影响质量。此外,您的 PDF 和转换后的 DOC 会在 2 小时后从服务器中删除,以确保您的隐私和文件安全。

为了加快 PDF 到 Word 的工作流程,iLovePDF 提供批量转换选项,通过同时转换多个 PDF 文件来帮助您节省大量时间。此外,您可以在实际转换过程之前重新排列、旋转、添加和删除 PDF。

优点:

集成 Google Drive 和 Dropbox 云服务

内置 OCR 功能

适用于所有平台

提供批量转换选项

快速、高质量的 PDF 到 Word 转换

缺点:

OCR 仅适用于高级用户

支持的平台: Windows、Mac、移动、基于网络

结论

最好的 PDF 到 Word 转换器软件肯定是您的武器库中需要的程序。它将保证您高质量的输出、提供可编辑的 Word 文件、提供批处理功能、提供 OCR 选项以及其他功能。

所有这些功能使您能够极其方便地获得所需的满意输出。本文概述了市场上消除搜索麻烦的最佳选择。选择适合您需求的 PDF 到 Word 转换器工具并充分利用它。