分类信息网站建设系统贸易公司做网站怎么样

目录

文章简介

1.研究内容

2.相关图件

3.文章引用

文章简介

论文名称:Increased population exposures to extreme precipitation in Central Asia under 1.5 ◦C and 2 ◦C global warming scenarios(在1.5°C和2°C全球变暖情景下,中亚地区暴露于极端降水的人口增加)

第一作者及单位:魏伟(博士生 中国科学院新疆生态与地理研究所)

文章发表期刊:《Geography and Sustainability》(中科院1区期刊|最新影响因子:9.8)

期刊平均审稿速度:18周(参考)

1.研究内容

在过去一个世纪,全球气温上升,并且在未来将持续上升。根据Clausius–Clapeyron方程预估全球温度每升高1℃,大气中的水汽约增加7%。降水以及极端降水的变化是气候变暖最具影响力的后果之一。未来温度升高,更多的地区和人口可能遭受越来越多的极端降水危害,特别是生态系统脆弱和基础设施不完善的中亚地区。而当前关于中亚地区未来极端降水对人口影响的相关研究缺乏,迫切需要进行精确的评估。

针对该问题,中国科学院新疆生态与地理研究所荒漠与绿洲生态国家重点实验室陈亚宁研究员团队选择了NEX-GDDP-CMIP6中的两种社会经济共享路径下(SSP2-4.5和SSP5-8.5)的10个全球气候模式的降水和气温数据。同时,结合2020年和未来(SSP2和SSP5)的人口数据,研究了在升温1.5℃和2℃条件下,中亚地区未来极端降水变化以及人口暴露程度。

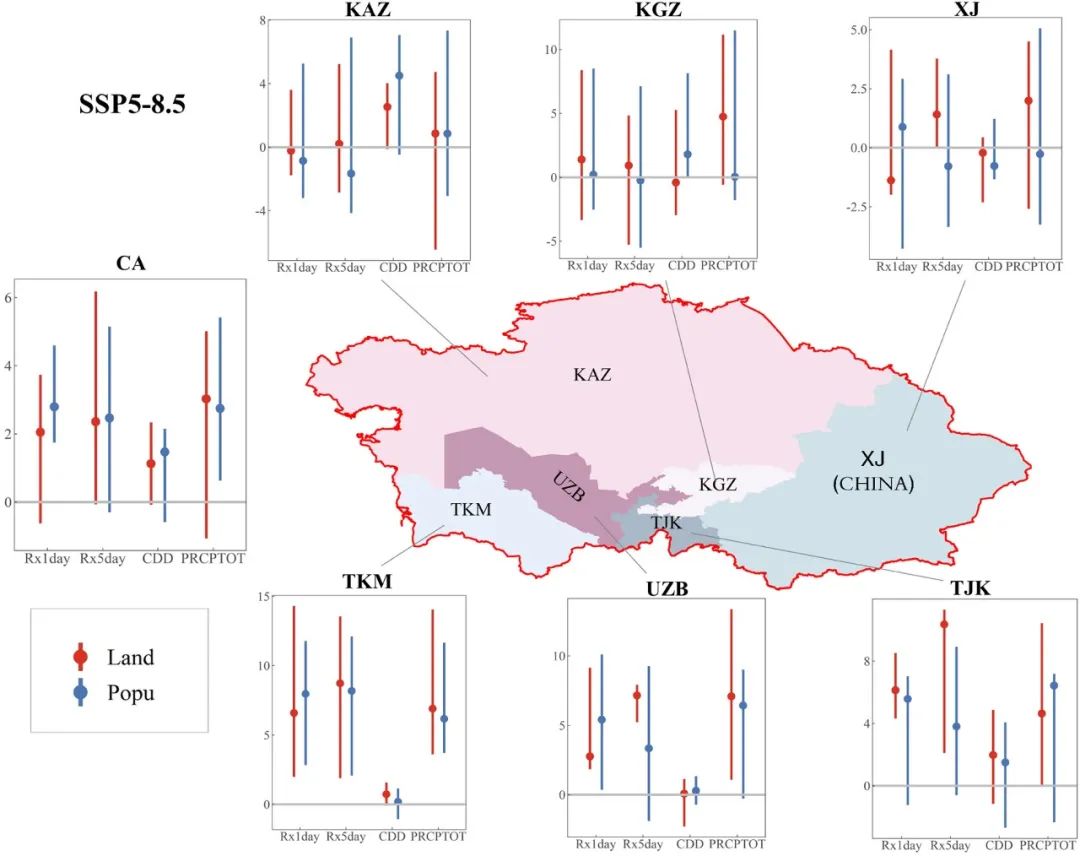

研究结果表明:未来中亚地区极端降水将随全球变暖而增加,SSP5-8.5情景下强降水对全球变暖的平均响应率为3.58%/K(1.99%/K -4.06%/K)。随气温升高,中亚越来越多的地区和人口将受到极端降水的影响。在升温1.5℃和2℃情况下,大约25%的人口(陆地面积)将分别暴露在增加幅度超过8.31% (9.32%)和14.18% (13.25%)的强降水中。而控制温度上升可以有效减少极端降水的人口暴露度和陆地面积暴露度。例如,将升温控制在1.5℃而不是2℃,Rx5day的人口暴露降低2.79%(1.75%-4.59%)。未来极端降水的人口暴露中气候变化是主导因素,人口再分配的作用较小,但却不可忽略。尤其是干旱期延长产生的影响中,人口再分配的作用是消极的。该研究将有助于全面认识极端降水及其影响,为决策者制定减缓和适应气候变化策略提供重要参考。

该研究得到新疆天山人才计划、国家自然科学基金和中国科学院西部之光基金项目资助。

2.相关图件

图1|研究区域的地图(a),包括行政区划、城市、主要河流和湖泊、数字高程模型以及中亚的位置。(b)2020年的人口分布。(c)2015年的土地覆盖。

图2.本研究采用的方法框架。

图3. 在SSP5-8.5情景下,中亚地区和各国在0.5°C全球变暖情况下的人口暴露情况。

3.文章引用

文章信息:Wei Wei, Shan Zou, Weili Duan, Yaning Chen, Shuai Li, Takahiro Sayama, Jianyu Zhu,Increased population exposures to extreme precipitation in Central Asia under 1.5 ℃ and 2 ℃ global warming scenarios,Geography and Sustainability,Volume 5,Issue 3,2024 ,Pages 343-356,ISSN 2666-6839,https://doi.org/10.1016/j.geosus.2024.02.005.